深度神经网络模型压缩方法与进展

Journal of East China Normal University(Natural Science)(2020)

摘要

深度神经网络(Deep Neural Network,DNN)模型通过巨大的内存消耗和高计算量来实现强大的性能,难以部署在有限资源的硬件平台上.通过模型压缩来降低内存成本和加速计算已成为热点问题,近年来已有大量的这方面的研究工作.主要介绍了4种具有代表性的深度神经网络压缩方法,即网络剪枝、量化、知识蒸馏和紧凑神经网络设计;着重介绍了近年来具有代表性的压缩模型方法及其特点;最后,总结了模型压缩的相关评价标准和研究前景.

更多AI 理解论文

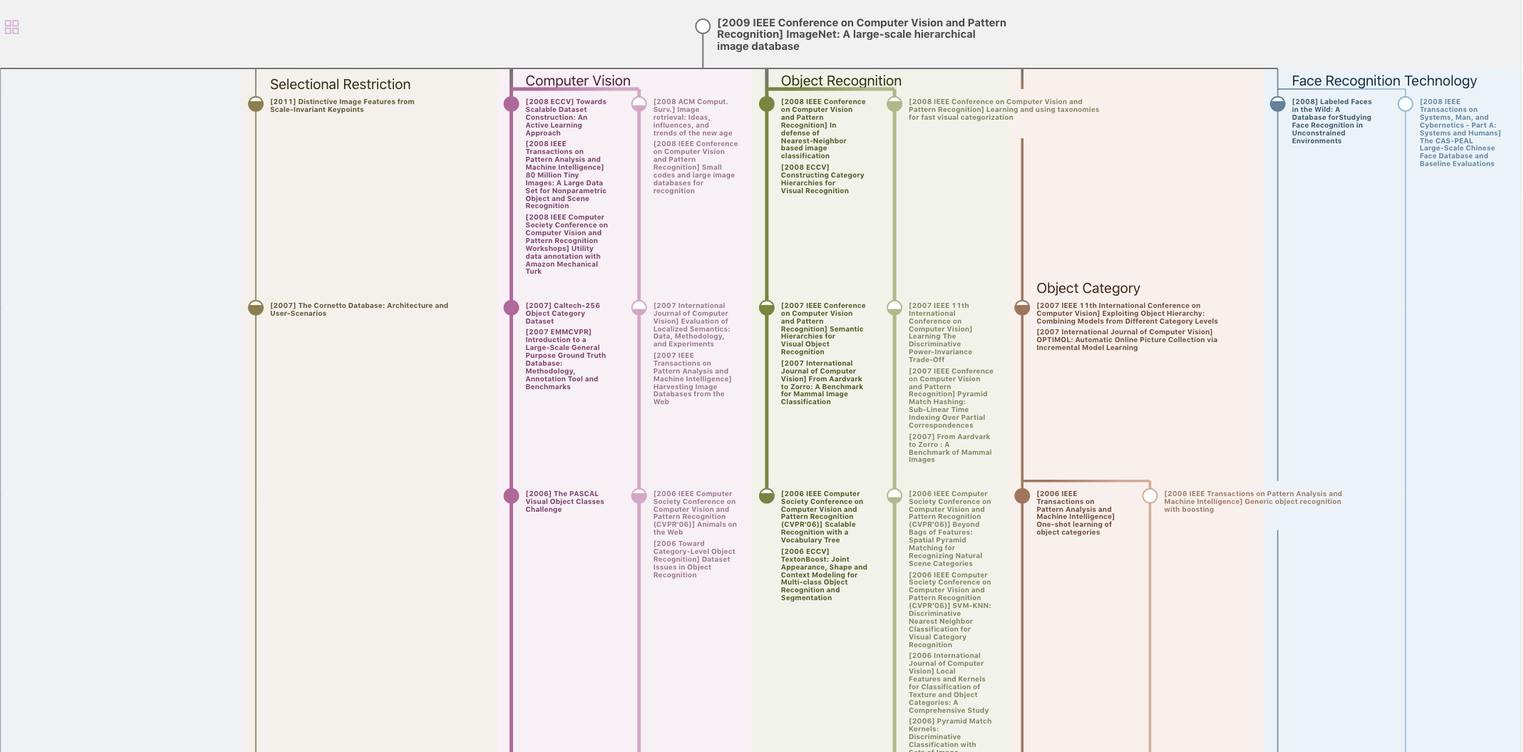

溯源树

样例

生成溯源树,研究论文发展脉络

Chat Paper

正在生成论文摘要