智能人机交互中第一视角手势表达的一次性学习分类识别

Acta Automatica Sinica(2021)

摘要

在智能人机交互中,以交互人的视角为第一视角的手势表达发挥着重要作用,而面向第一视角的手势识别则成为最重要的技术环节.本文通过深度卷积神经网络的级联组合,研究复杂应用场景中第一视角下的一次性学习手势识别(One-shot learning hand gesture recognition,OSLHGR)算法.考虑到实际应用的便捷性和适用性,运用改进的轻量级SSD(Single shot multibox detector)目标检测网络实现第一视角下手势目标的快速精确检测;进而,以改进的轻量级U-Net网络为主要工具进行复杂背景下手势目标的像素级高效精准分割.在此基础上,以组合式3D深度神经网络为工具,研究提出了一种第一视角下的一次性学习手势动作识别的网络化算法.在Pascal VOC 2012数据集和SoftKinetic DS325采集的手势数据集上进行的一系列实验测试结果表明,本文所提出的网络化算法在手势目标检测与分割精度、分类识别准确率和实时性等方面都有显著的优势,可为在复杂应用环境下实现便捷式高性能智能人机交互提供可靠的技术支持.

更多AI 理解论文

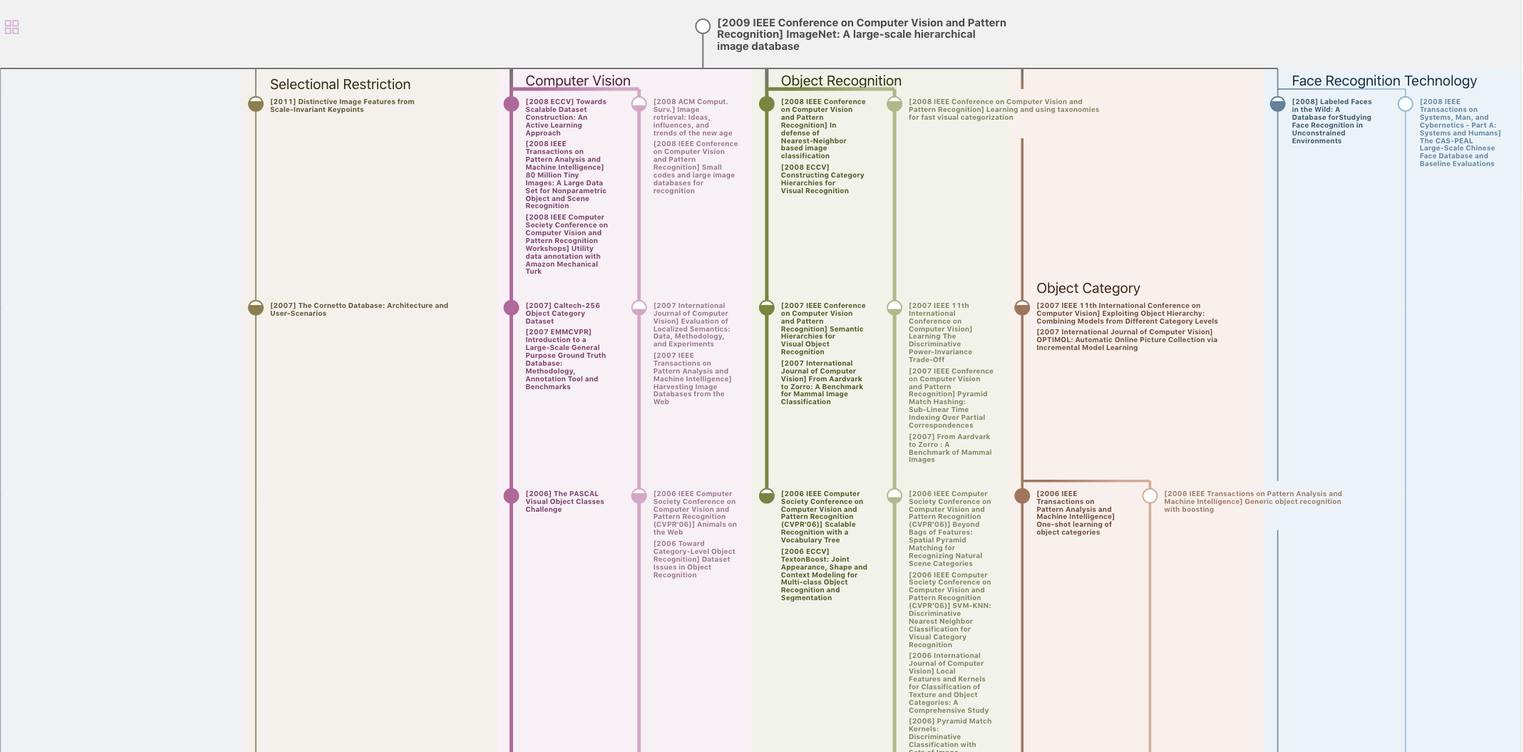

溯源树

样例

生成溯源树,研究论文发展脉络

Chat Paper

正在生成论文摘要