基于多维特征图知识蒸馏的对抗样本防御方法

Chinese Journal of Network and Information Security(2022)

摘要

计算机视觉领域倾向使用深度神经网络完成识别任务,但对抗样本会导致网络决策异常.为了防御对抗样本,主流的方法是对模型进行对抗训练.对抗训练存在算力高、训练耗时长的缺点,其应用场景受限.提出一种基于知识蒸馏的对抗样本防御方法,将大型数据集学习到的防御经验复用到新的分类任务中.在蒸馏过程中,教师模型和学生模型结构一致,利用模型特征图向量作为媒介进行经验传递,并只使用干净样本训练.使用多维度特征图强化语义信息的表达,并且提出一种基于特征图的注意力机制,将特征依据重要程度赋予权重,增强蒸馏效果.所提算法在Cifar100、Cifar10等开源数据集上进行实验,使用FGSM(fast gradient sign method)、PGD(project gradient descent)、C&W(Carlini-Wagner attack)等算法进行白盒攻击,测试实验效果.所提方法在Cifar10干净样本的准确率超过对抗训练,接近模型在干净样本正常训练的准确率.在L2距离的PGD攻击下,所提方法效果接近对抗训练,显著高于正常训练.而且其学习成本小,即使添加注意力机制和多维度特征图等优化方案,算力需求依然远小于对抗训练,是一种轻量级的对抗防御方法.知识蒸馏作为一种神经网络学习方案,不仅能够学习正常样本的决策经验,而且可以提取鲁棒性特征.使用少量数据生成准确而鲁棒的模型,可以提高泛化能力,减少对抗训练带来的成本.

更多查看译文

关键词

deep learning,adversarial examples defense,knowledge distillation,multi-dimensional feature maps

AI 理解论文

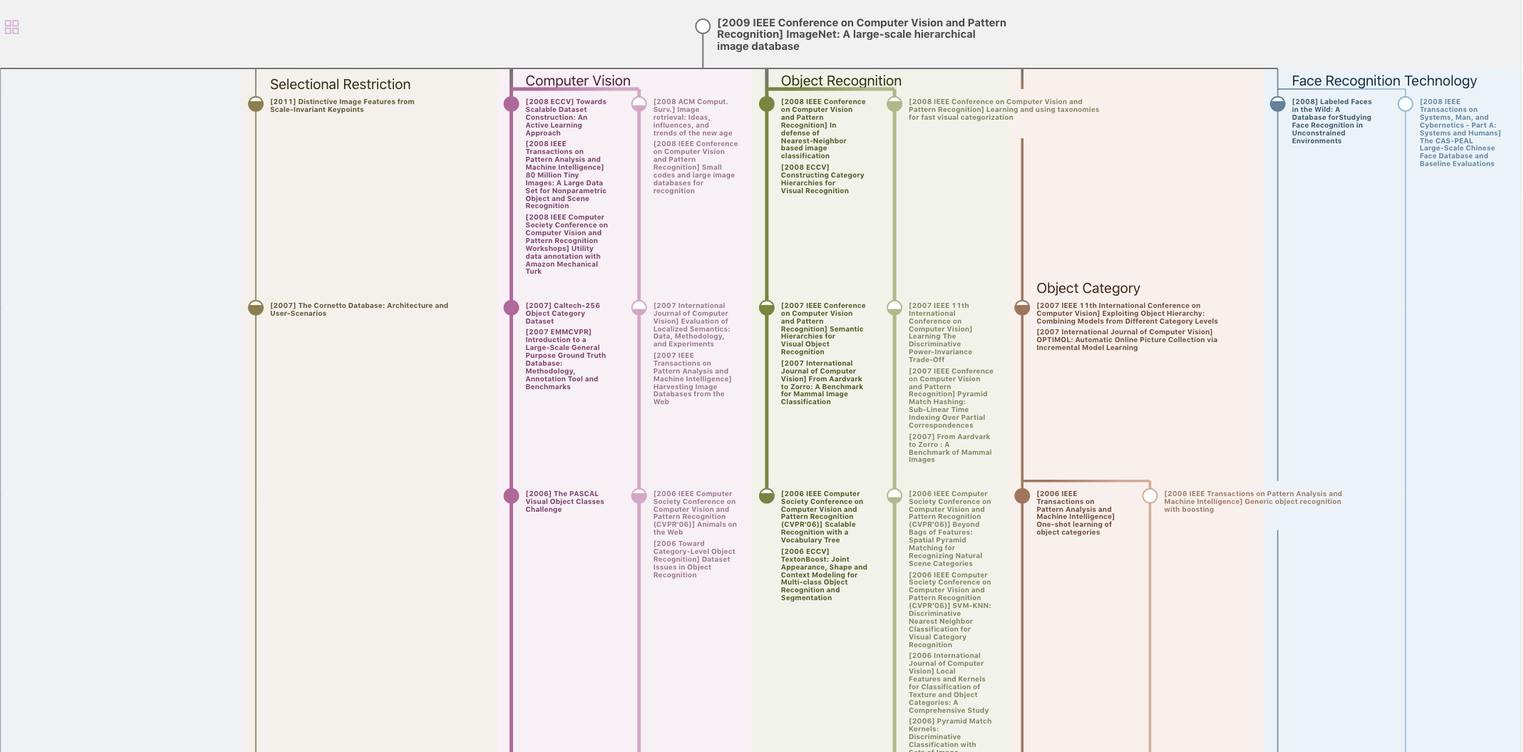

溯源树

样例

生成溯源树,研究论文发展脉络

Chat Paper

正在生成论文摘要