SikuBERT与SikuRoBERTa:面向数字人文的《四库全书》预训练模型构建及应用研究

Library Tribune(2022)

摘要

数字人文研究需要大规模语料库和高性能古文自然语言处理工具的支持.面向英语和现代汉语的预训练语言模型已在相关领域提升了文本挖掘精度,数字人文研究的兴起亟须面向古文自动处理领域的预训练模型.文章以校验后的高质量《四库全书》全文语料作为无监督训练集,基于BERT模型框架,构建面向古文智能处理任务的SikuBERT和SikuRoBERTa预训练语言模型.实验进一步设计面向《左传》语料的古文自动分词、断句标点、词性标注和命名实体识别等验证任务,分别对SikuBERT、SikuRoBERTa预训练模型和其他3种基线模型(BERT-base、RoBERTa、Gu?wenBERT)进行对比试验.结果显示:SikuBERT和SikuRoBERTa模型在全部4个下游验证任务中的表现均超越其他基线预训练模型,表明文章提出的预训练模型具有较强的古文词法、句法、语境学习能力和泛化能力.基于验证任务效果最优的SikuRoBERTa预训练模型,进一步构建"SIKU-BERT典籍智能处理平台".该平台提供典籍自动处理、检索和自动翻译等在线服务,可以辅助哲学、文学、历史学等领域学者在不具备数据挖掘与深度学习的专业背景下,以直观可视化方式对典籍文本进行高效率、多维度、深层次、细粒化的知识挖掘与分析.

更多AI 理解论文

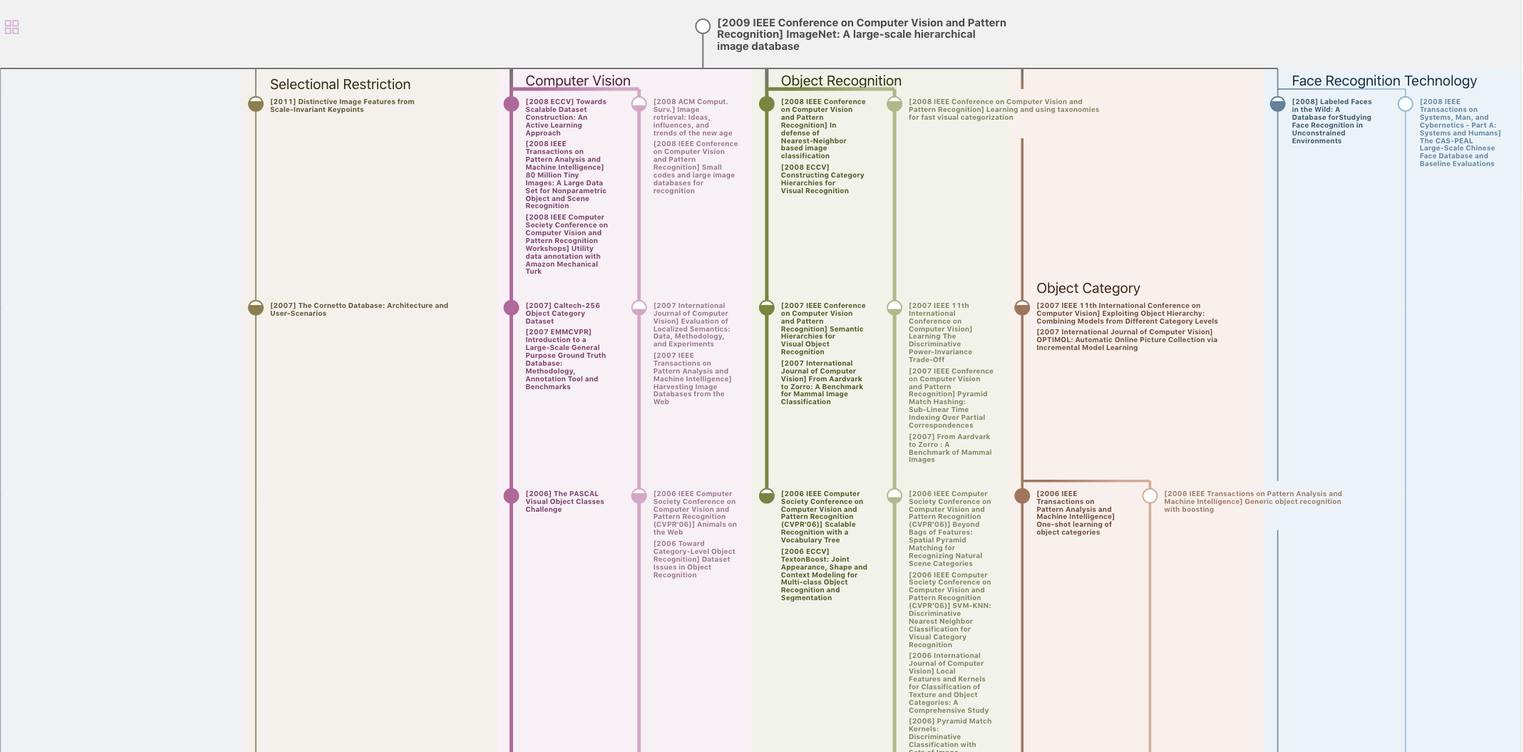

溯源树

样例

生成溯源树,研究论文发展脉络

Chat Paper

正在生成论文摘要