基于合作博弈和知识蒸馏的个性化联邦学习算法

Journal of Electronics & Information Technology(2023)

摘要

为克服联邦学习(FL)客户端数据和模型均需同构的局限性并且提高训练精度,该文提出一种基于合作博弈和知识蒸馏的个性化联邦学习(pFedCK)算法.在该算法中,每个客户端将在公共数据集上训练得到的局部软预测上传到中心服务器并根据余弦相似度从服务器下载最相近的k个软预测形成一个联盟,然后利用合作博弈中的夏普利值(SV)来衡量客户端之间多重协作的影响,量化所下载软预测对本地个性化学习效果的累计贡献值,以此确定联盟中每个客户端的最佳聚合系数,从而得到更优的聚合模型.最后采用知识蒸馏(KD)将聚合模型的知识迁移到本地模型,并在隐私数据集上进行本地训练.仿真结果表明,与其他算法相比,pFedCK算法可以将个性化精度提升约10%.

更多查看译文

关键词

Personalized Federated Learning(PFL),Collation game,Knowledge Distillation(KD),Heterogeneity

AI 理解论文

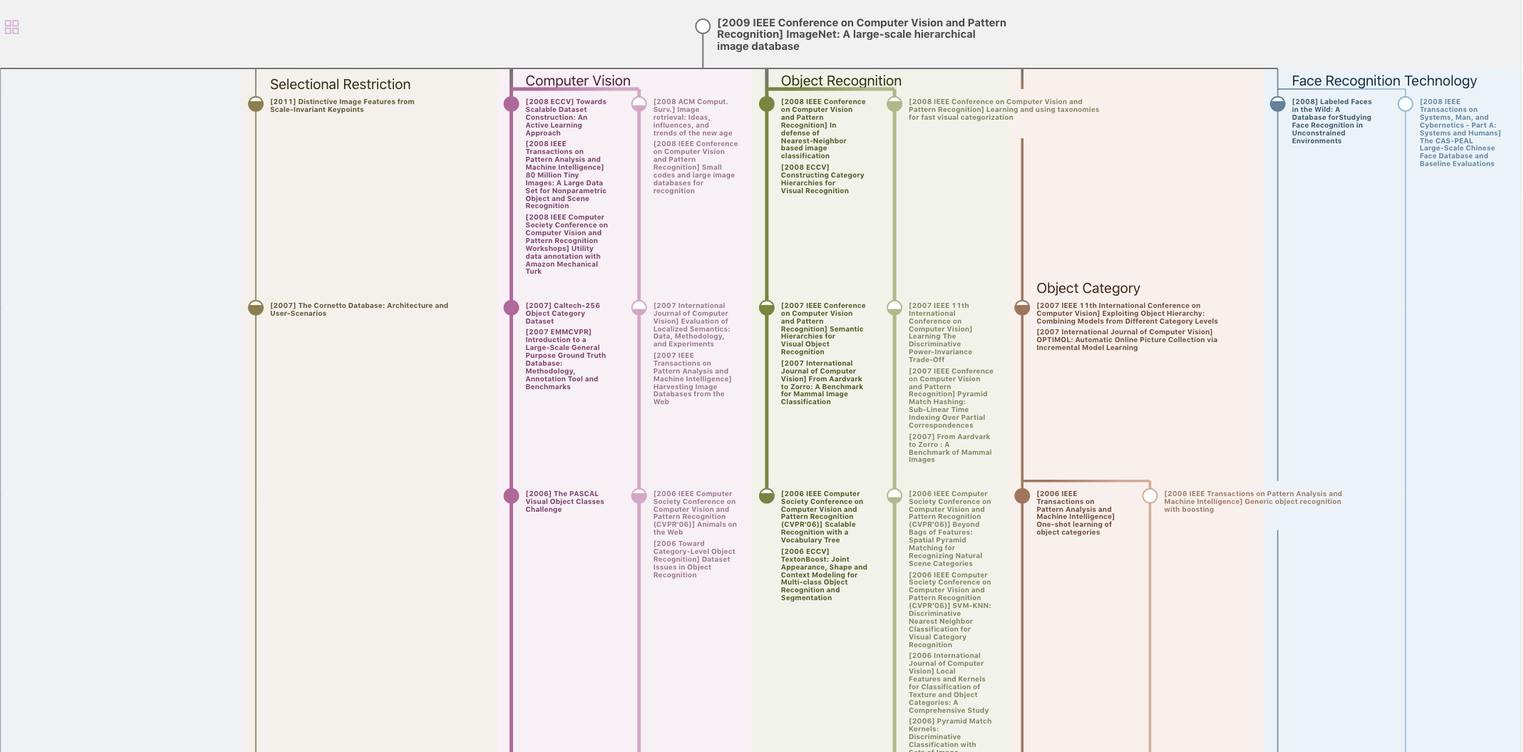

溯源树

样例

生成溯源树,研究论文发展脉络

Chat Paper

正在生成论文摘要